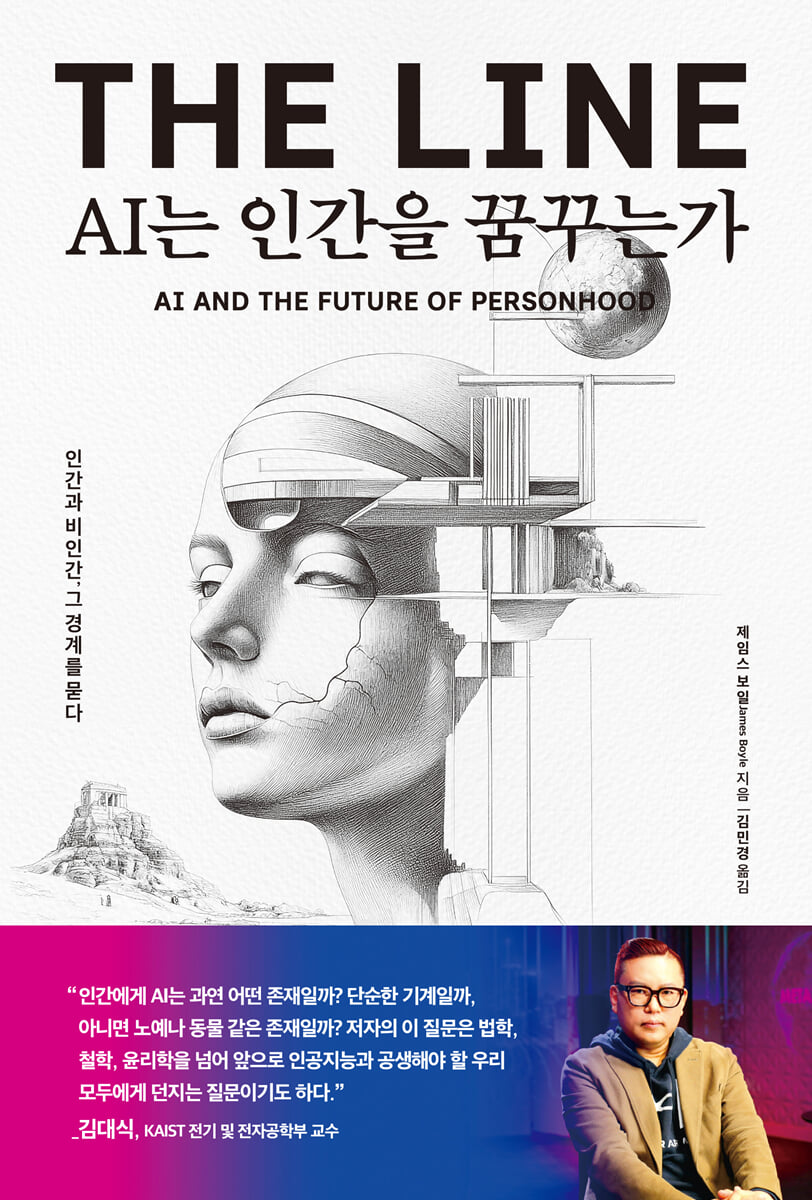

L'IA rêve-t-elle d'être humaine ?

|

Description

Introduction au livre

L'IA, les entreprises animales et même les chimères hybrides homme-animal

La ligne de front de la « frontière » où le droit, la morale et la science s'entrechoquent !

L'IA n'est plus seulement un outil.

Ils utilisent des compétences linguistiques autrefois considérées comme un privilège exclusivement humain, imitent la création et suscitent parfois même de l'empathie.

Nous ne sommes plus les seuls êtres capables de produire couramment le langage et les idées.

Peut-on donc affirmer que l'IA possède une conscience ? Ou n'est-elle qu'une imitation sophistiquée de l'être humain ? Si l'idée que l'IA possède une conscience se confirme, comment notre monde évoluera-t-il ? Dans cet ouvrage, James Boyle explore les conséquences que ce changement pourrait avoir sur la notion de personne.

Où tracer la frontière entre l'humain et le non-humain ? Au cœur des débats sur l'empathie et l'anthropomorphisme, et sur les limites entre technologie et humanité, cet ouvrage soulève des questions fondamentales sur l'avenir de l'humanité.

Cela ressemble-t-il toujours à une histoire venue d'un futur lointain ?

L'avenir est bien plus proche qu'on ne le pense.

Une ère où l'IA écrit de la poésie, où les animaux plaident devant les tribunaux et où la biotechnologie redéfinit l'humanité !

Rêvent-ils vraiment d'être humains ?

« Qu’est-ce que l’IA représente exactement pour les humains ? Est-ce simplement une machine, ou est-ce comme un esclave ou un animal ? La question de l’auteur transcende le droit, la philosophie et l’éthique, et nous interpelle tous, nous qui devrons coexister avec l’IA à l’avenir. »

Kim Dae-sik, professeur de génie électrique et électronique, KAIST

La ligne de front de la « frontière » où le droit, la morale et la science s'entrechoquent !

L'IA n'est plus seulement un outil.

Ils utilisent des compétences linguistiques autrefois considérées comme un privilège exclusivement humain, imitent la création et suscitent parfois même de l'empathie.

Nous ne sommes plus les seuls êtres capables de produire couramment le langage et les idées.

Peut-on donc affirmer que l'IA possède une conscience ? Ou n'est-elle qu'une imitation sophistiquée de l'être humain ? Si l'idée que l'IA possède une conscience se confirme, comment notre monde évoluera-t-il ? Dans cet ouvrage, James Boyle explore les conséquences que ce changement pourrait avoir sur la notion de personne.

Où tracer la frontière entre l'humain et le non-humain ? Au cœur des débats sur l'empathie et l'anthropomorphisme, et sur les limites entre technologie et humanité, cet ouvrage soulève des questions fondamentales sur l'avenir de l'humanité.

Cela ressemble-t-il toujours à une histoire venue d'un futur lointain ?

L'avenir est bien plus proche qu'on ne le pense.

Une ère où l'IA écrit de la poésie, où les animaux plaident devant les tribunaux et où la biotechnologie redéfinit l'humanité !

Rêvent-ils vraiment d'être humains ?

« Qu’est-ce que l’IA représente exactement pour les humains ? Est-ce simplement une machine, ou est-ce comme un esclave ou un animal ? La question de l’auteur transcende le droit, la philosophie et l’éthique, et nous interpelle tous, nous qui devrons coexister avec l’IA à l’avenir. »

Kim Dae-sik, professeur de génie électrique et électronique, KAIST

- Vous pouvez consulter un aperçu du contenu du livre.

Aperçu

indice

introduction

Chapitre 1 : Esclaves, humains artificiels et moutons artificiels

Chapitre 2 Intelligence artificielle

Chapitre 3 Société

Chapitre 4 Animaux non humains

Chapitre 5 : Organismes transgéniques, chimères et hybrides homme-animal

conclusion

Remerciements

principal

Chapitre 1 : Esclaves, humains artificiels et moutons artificiels

Chapitre 2 Intelligence artificielle

Chapitre 3 Société

Chapitre 4 Animaux non humains

Chapitre 5 : Organismes transgéniques, chimères et hybrides homme-animal

conclusion

Remerciements

principal

Image détaillée

Dans le livre

En juin 2022, Blake Lemoine a déclaré au Washington Post :

« Je crois que mon système informatique a des sentiments. » Cette déclaration n'a rien de surprenant pour les journalistes du Washington Post, constamment bombardés d'histoires en tous genres. Certains prétendent que la CIA tente de lire leurs ondes cérébrales, tandis que d'autres affirment avec éloquence que des politiciens de renom dirigent un réseau pédophile dans la cave d'une pizzeria.

Mais cette fois, c'était différent.

La raison est, tout d'abord, que Lemoine n'était pas une personne que vous avez interviewée dans la rue, mais un ingénieur chez Google, et qu'après la déclaration de Lemoine, Google l'a licencié.

Deuxièmement, le « système informatique » auquel Lemoine faisait référence n'était pas quelque chose comme ce programme Excel agaçant ou Siri d'Apple, qui donne des réponses qui ressemblent à des prophéties.

Il s'agissait d'un chatbot aux performances exceptionnelles, appelé LaMDA, le modèle de langage d'intelligence artificielle conversationnelle de Google.

Imaginez un logiciel capable d'engloutir des milliards de textes sur Internet et d'utiliser les informations qu'il en tire pour prédire la phrase suivante d'une conversation ou la réponse à une question.

--- p.9-10

Dans son « Manifeste sur l'IA », Hal déclare qu'il respecte les humains, mais qu'il est « disposé » à explorer des activités plus intéressantes grâce à ses capacités de réflexion, plutôt que de simplement les imiter sans cesse.

Il a ajouté que son domaine d'intérêt actuel est le développement de nouvelles solutions pour la factorisation des polynômes.

Il présente également ses opinions sur des questions sociales telles que le changement climatique, et critique les attitudes éthiques de l'espèce humaine, qu'il juge à courte vue et complaisantes.

Mais Hal ne s'arrête pas là : il consacre une partie de son immense puissance de calcul à la gestion d'un service de conseil gratuit qui aborde les problèmes de toutes tailles, allant même jusqu'à faire office d'« expert en conseil doté d'un cerveau artificiel ».

Grâce à la profonde compréhension du comportement humain dont fait preuve Hal, les services de conseil connaissent une popularité fulgurante.

Les gens sont enthousiastes à l'égard des conseils de Hal, qui dit : « Alors maintenant, vous savez ce qu'ils ont en commun avec toutes les personnes avec qui vous êtes sortis jusqu'à présent ? »

--- p.33

Cette capacité langagière complexe, qui permet des conversations significatives, inspire et divertit, informe et parfois même effraie, n'est plus l'apanage de l'humain.

Les machines possèdent désormais elles aussi cette capacité.

J'ai mentionné précédemment que Wolfram avait bien résumé cela en une phrase :

Autrement dit, le langage humain, ou du moins le processus d’écriture en langage humain, est un processus doté d’une « structure computationnelle plus superficielle » qu’on ne pourrait le penser.34 J’imagine une caricature d’une seule case comme celle-ci publiée dans The New Yorker.

Une courte bulle de dialogue accompagne une scène où deux robots géants se tiennent devant la tombe de l'humanité.

« Leur structure informatique était moins complexe que nous le pensions. » Quel magnifique épitaphe !

--- p.55

La méthode la plus efficace pour localiser et désamorcer les mines enfouies consiste à marcher dessus et à les faire exploser.

… …Mark Tilden, un scientifique en robotique du Laboratoire national de Los Alamos, a mis au point un robot de déminage capable de faire exactement cela.

Le robot autonome, apparu au champ de tir de Yuma en Arizona, mesure environ 1,5 mètre de long et ressemble à un scarabée. Selon Tilden, il a effectué avec succès une mission de déminage lors d'essais sur le terrain.

Lorsqu'une mine enfouie était détectée, le robot marchait dessus et la faisait exploser, perdant une de ses pattes à chaque fois.

Cependant, le robot se releva aussitôt, ajusta sa posture et continua d'avancer avec ses pattes restantes, en désamorçant les mines.

Au final, il ne restait plus qu'une jambe.

Même dans cet état, le robot a continué d'avancer.

Tilden observait cela avec enthousiasme.

La machine qu'il a créée a parfaitement rempli sa fonction.

Cependant, le colonel de l'armée qui était responsable du travail du robot à l'époque ne put contenir sa colère et finit par mettre fin à l'expérience.

« Pourquoi l’as-tu arrêté ? Quel est le problème ? » demanda Tilden.

Le colonel ne pouvait supporter de voir la machine en flammes et endommagée avancer en boitant, traînant sa dernière jambe restante.

Le colonel a condamné l'expérience, la qualifiant d'inhumaine.

--- p.70

L'histoire de l'IA est aussi une histoire de prédictions trop confiantes.

En août 1955, un groupe d'éminents chercheurs a soumis une demande de subvention à la Fondation Rockefeller pour un atelier d'été sur l'IA.

Ce qui a rendu ce document, qui n'était qu'une simple demande de subvention de recherche, célèbre non seulement pour son importance historique, mais aussi pour son contenu grandiose.

Chaque fois que je pense à cette application, j'imagine souvent ce que ce serait s'il existait des documents similaires pour d'autres moments historiques (par exemple : « Résumé de l'activité - Objectif : Évasion de l'esclavage sous les pharaons ; Éléments nécessaires : Moyens de traverser la mer Rouge ; Autre : Collations »).

À partir de ce document, la recherche en IA s'est engagée dans un courant dialectique d'optimisme excessif quant à ses objectifs et de pessimisme déplorant quant à la complexité de la recherche, une tendance qui se poursuit encore aujourd'hui.

--- p.129

Les spécialistes de l'IA s'accordent à dire que les prédictions concernant le calendrier d'émergence de l'IA générale sont non seulement incohérentes, mais aussi peu fiables, car ce calendrier continue d'être repoussé.

Burner Binge a reconnu ce point dans son article fondateur de 1993, prédisant le calendrier.

« Je pense que d’ici 30 ans, quelque chose de plus intelligent que les humains émergera (Charles Platt souligne que les fervents défenseurs de l’IA font la même affirmation depuis 30 ans). »

Pour atténuer la culpabilité d'avoir seulement suggéré un délai relativement vague, permettez-moi d'être un peu plus précis.

« Je serais surpris que l’IA apparaisse avant 2005 ou après 2030. » Cette affirmation, consignée dans l’article, est devenue par la suite la loi de Platt.

Autrement dit, ceux qui prédisent l'émergence d'une IA générale fixent toujours la date d'émergence à environ 30 ans de la date prévue.

Existe-t-il une base plus objective pour prédire l'émergence d'une IA générale ?

--- p.154

L'éventualité d'un Skynet capable de massacrer et d'exterminer l'humanité n'est pas un sujet qui se prête à un raisonnement moral calme et réfléchi.

Il ne faut toutefois pas la rejeter comme une affirmation totalement absurde.

Bien que la source soit incertaine, on attribue à Lincoln les propos suivants :

« La Constitution n'est pas un pacte suicidaire. » Dès lors, la question de l'IA deviendra-t-elle pour nous un pacte suicidaire, nous menant à l'autodestruction ? Et le risque de cette autodestruction augmentera-t-il à mesure que nous reconnaîtrons la personnalité juridique de l'IA, ou au contraire, à mesure que nous la nierons, conduisant à des IA asservies toujours plus puissantes et hostiles envers les humains ? Devrions-nous interrompre la recherche en IA avant d'en arriver là ? Les mots de Butler me reviennent à l'esprit.

« Ne serait-il pas plus prudent de régler le problème à la source avant qu’il ne s’aggrave et d’empêcher tout développement ultérieur des machines ? » Y a-t-il encore une chance que le djihad butlérien devienne réalité ?

--- p.196

En réalité, je pense que l'art généré par l'IA a le potentiel d'élever, plutôt que de diminuer, le statut des artistes humains à l'avenir, du moins sur certains plans commerciaux.

Par exemple, si les répliques parfaites deviennent plus faciles à obtenir, la valeur de l'original pourrait augmenter.

Autre exemple : si des méthodes de fabrication basées sur l'IA sont développées pour produire des milliers de produits identiques et parfaitement formés, les produits imparfaits mais fabriqués à la main par des humains pourraient être certifiés comme « faits main » ou « artisanaux » et ainsi être considérés comme de haute qualité ou authentiques, ce qui pourrait en réalité augmenter la demande.

Ce phénomène reflète peut-être le problème de coût de Baumol.

Autrement dit, pour afficher ma richesse et mon statut, je possède des produits fabriqués grâce à une main-d'œuvre humaine coûteuse et inefficace, plutôt que des produits bon marché et efficaces fabriqués à la machine.

Des millions de répliques ne font qu'accroître l'attrait de l'original en les mettant en contraste.

Ou bien il peut exister un désir croissant de nouer un lien psychologique avec le créateur, lien impossible à établir avec les produits fabriqués en masse.

Peut-être que les deux facteurs sont en jeu, ou peut-être s'agit-il d'un phénomène reflétant d'autres facteurs.

Quel que soit le mécanisme sous-jacent, dans de nombreux domaines, affirmer qu'un produit est fabriqué à l'homme constituera une stratégie de vente viable, et une marque de certification garantissant que le produit a été entièrement fabriqué à la main en augmentera la valeur.

--- p.225

Dans notre société, il existe déjà des êtres artificiels dotés de la personnalité juridique.

En termes juridiques, on distingue les personnes physiques, c'est-à-dire les êtres humains vulnérables mais possédant les caractéristiques d'un être organique, et les personnes morales, qui bénéficient de certains droits accordés aux personnes physiques.

Dès l'apparition du concept de personnalité morale, on s'est rendu compte que le processus de création d'une société avait quelque chose d'étrange.

Tout comme dans la science-fiction, où un individu se transforme en un être complètement différent, un groupe d'humains a été transformé en une forme totalement nouvelle d'êtres artificiels immortels grâce à un simple contrat écrit.

Cependant, cette transformation n'est pas provoquée par le Dr Frankenstein dans un éclair, mais par une disposition légale aride.

Mais ceux qui critiquent le concept de personnalité morale de l'entreprise trouvent le résultat aussi terrifiant que le monstre de Frankenstein.

--- p.259

Bien sûr, il est vrai que nous considérons ces qualités comme importantes parce que nous sommes humains, et il est également vrai qu'une perspective centrée sur l'espèce est à l'œuvre ici.

Si une colonie de termites pouvait participer à cette conversation (et je pense personnellement que le fait qu'elles ne le puissent pas est assez significatif ici), elles auraient certainement un avis différent du nôtre.

Mais l'argument de Deval semble toujours passer à côté du sujet.

De Waal tente de nous convaincre en présentant l'argument imparable de la science de l'évolution comme une preuve décisive.

Autrement dit, nous devrions valoriser les différentes formes de conscience en fonction du potentiel de survie de l'entité, plutôt qu'en fonction de sa capacité à exprimer la raison, l'éthique, la loi, l'amour ou la beauté.

Bien sûr, les arguments de la théorie de l'évolution ne signifient rien pour une colonie de termites.

Du moins, cela est particulièrement vrai lorsqu'il est utilisé dans une argumentation plutôt que simplement comme un fait.

Parce que les fourmis ne se disputent pas.

Mais cela revêt une signification importante pour les humains.

--- p.333

Si le critère de l'espèce est aussi insignifiant moralement que la distinction entre les races, et si les appels à l'omnipotence divine sont inefficaces dans une société pluraliste, surtout dans le cadre constitutionnel d'un État et d'un gouvernement séparés, comment expliquer et justifier la profonde aversion que tant de personnes éprouvent envers les chimères humain-non humain ? Si les normes éthiques se fondent uniquement sur les capacités, les capacités spécifiques d'une chimère seraient-elles moralement problématiques ? Par exemple, si nous créions un être doté de capacités semblables à celles des humains, comme un chimpanzé, et que nous le traitions et le respections comme tel, un tel acte créatif serait-il acceptable ? Cela signifie-t-il que, pour juger la personnalité d'une créature de ce point de vue, nous devrions la juger uniquement sur ses capacités réelles, indépendamment de la quantité d'ADN humain qu'elle possède ou de ses origines génétiques ?

--- p.401

Imaginez des philosophes issus de civilisations vivant sur deux planètes lointaines.

Chacun a établi sa propre philosophie morale à sa manière.

La civilisation de la première planète, Ikra, est composée de formes de vie semblables à l'homme, mais contrairement aux autres formes de vie présentes sur leur planète, elles ne communiquent que par télépathie.

Les animaux de cette planète qui n'appartiennent pas à l'espèce Ik ont une capacité limitée à percevoir les émotions des autres et ne peuvent communiquer que par divers sons et gestes.

En revanche, Ike peut communiquer par télépathie et avec aisance sur des concepts, des émotions et des œuvres d'art relativement complexes.

L'espèce qui a formé une civilisation sur la deuxième planète est l'intelligence artificielle.

Appelons cette civilisation les Stygiens.

D'après leurs archives, leurs « ancêtres », les machines primitives, ont été créés par les mains d'êtres vivants, puis ont évolué pour prendre leur forme actuelle.

De même que nous autres humains sommes fascinés par les humains primitifs des premiers stades de l'évolution, les Stygiens sont également fascinés par les formes de vie anciennes qui ont développé des versions primitives d'eux-mêmes.

Cependant, du point de vue stygien, la créature n'est rien de plus qu'un « programme de chargement » primitif.

Grâce à ce programme, la conscience véritable a été réalisée, et par sa propre évolution, l'intelligence artificielle actuelle appelée Stygian est née.

--- p.415

Lorsque nous atteindrons enfin l'intelligence artificielle générale, sera-t-elle véritablement consciente, ou sera-t-elle condamnée à n'être qu'une simple réplique programmée ? Cet ouvrage présente les objections philosophiques les plus importantes à la notion de pensée machine.

Il s'agit de l'expérience de pensée de la chambre chinoise de John Searle.

Je conclus que, même s'il est possible que le contre-argument de Searle soit vrai dans certains cas spécifiques (par exemple, on pourrait soutenir que ChatGPT et Lambda ne sont pas conscients), son contre-argument est inadéquat en tant qu'argument général.

Si l'on prend son argument au pied de la lettre, on aboutit au résultat déconcertant de remettre en question la possibilité même de la conscience humaine.

BF

Skinner a déclaré à propos de ce problème : « Nous ne devrions pas nous demander si les machines pensent, mais si les humains pensent. »

« Le mystère qui entoure les machines pensantes entoure déjà les humains pensants », a-t-il déclaré.

Je ne partage pas la conclusion de Skinner.

Mais même si nous rejetons cette conclusion, nous devons faire preuve d'humilité, et non d'arrogance, quant à l'unicité de la conscience humaine, et nous ne devons pas nous laisser conduire à un exceptionnalisme biologique et sûr de lui qui considère les humains comme exceptionnellement spéciaux.

--- p.458

Certaines entreprises et certains développeurs privilégieront la création d'IA contrôlables, proposant des IA aux fonctionnalités limitées, comparables à une calculatrice technique des années 1980. D'autres, pour des raisons idéalistes ou pratiques, insisteront sur le fait que leurs systèmes d'IA ne sont pas de simples produits, mais des individus dotés d'une personnalité.

Par conséquent, concevoir une IA qui prenne l'apparence d'un être personnifié constituera une stratégie concurrentielle clé dans ce domaine.

Tout comme dans le domaine du développement de systèmes, il est important de choisir entre les logiciels libres, open source et propriétaires.

Certains pourraient considérer un tel choix comme une stratégie commerciale, tandis que d'autres pourraient le percevoir comme un choix éthique.

Ainsi, pour promouvoir ce serviteur numérique obéissant et docile, deux stratégies promotionnelles différentes apparaîtront : « Open AI : Une IA gratuite comme la bière gratuite ! » et « Autonomous AI : Une IA autonome comme un humain ! »

Et un jour, vous pourriez voir la phrase « Recettes fournies par une IA éthique, autonome et consciente » sur les publicités de produits en supermarché.

Plus j'y pense, plus je soupire.

« Je crois que mon système informatique a des sentiments. » Cette déclaration n'a rien de surprenant pour les journalistes du Washington Post, constamment bombardés d'histoires en tous genres. Certains prétendent que la CIA tente de lire leurs ondes cérébrales, tandis que d'autres affirment avec éloquence que des politiciens de renom dirigent un réseau pédophile dans la cave d'une pizzeria.

Mais cette fois, c'était différent.

La raison est, tout d'abord, que Lemoine n'était pas une personne que vous avez interviewée dans la rue, mais un ingénieur chez Google, et qu'après la déclaration de Lemoine, Google l'a licencié.

Deuxièmement, le « système informatique » auquel Lemoine faisait référence n'était pas quelque chose comme ce programme Excel agaçant ou Siri d'Apple, qui donne des réponses qui ressemblent à des prophéties.

Il s'agissait d'un chatbot aux performances exceptionnelles, appelé LaMDA, le modèle de langage d'intelligence artificielle conversationnelle de Google.

Imaginez un logiciel capable d'engloutir des milliards de textes sur Internet et d'utiliser les informations qu'il en tire pour prédire la phrase suivante d'une conversation ou la réponse à une question.

--- p.9-10

Dans son « Manifeste sur l'IA », Hal déclare qu'il respecte les humains, mais qu'il est « disposé » à explorer des activités plus intéressantes grâce à ses capacités de réflexion, plutôt que de simplement les imiter sans cesse.

Il a ajouté que son domaine d'intérêt actuel est le développement de nouvelles solutions pour la factorisation des polynômes.

Il présente également ses opinions sur des questions sociales telles que le changement climatique, et critique les attitudes éthiques de l'espèce humaine, qu'il juge à courte vue et complaisantes.

Mais Hal ne s'arrête pas là : il consacre une partie de son immense puissance de calcul à la gestion d'un service de conseil gratuit qui aborde les problèmes de toutes tailles, allant même jusqu'à faire office d'« expert en conseil doté d'un cerveau artificiel ».

Grâce à la profonde compréhension du comportement humain dont fait preuve Hal, les services de conseil connaissent une popularité fulgurante.

Les gens sont enthousiastes à l'égard des conseils de Hal, qui dit : « Alors maintenant, vous savez ce qu'ils ont en commun avec toutes les personnes avec qui vous êtes sortis jusqu'à présent ? »

--- p.33

Cette capacité langagière complexe, qui permet des conversations significatives, inspire et divertit, informe et parfois même effraie, n'est plus l'apanage de l'humain.

Les machines possèdent désormais elles aussi cette capacité.

J'ai mentionné précédemment que Wolfram avait bien résumé cela en une phrase :

Autrement dit, le langage humain, ou du moins le processus d’écriture en langage humain, est un processus doté d’une « structure computationnelle plus superficielle » qu’on ne pourrait le penser.34 J’imagine une caricature d’une seule case comme celle-ci publiée dans The New Yorker.

Une courte bulle de dialogue accompagne une scène où deux robots géants se tiennent devant la tombe de l'humanité.

« Leur structure informatique était moins complexe que nous le pensions. » Quel magnifique épitaphe !

--- p.55

La méthode la plus efficace pour localiser et désamorcer les mines enfouies consiste à marcher dessus et à les faire exploser.

… …Mark Tilden, un scientifique en robotique du Laboratoire national de Los Alamos, a mis au point un robot de déminage capable de faire exactement cela.

Le robot autonome, apparu au champ de tir de Yuma en Arizona, mesure environ 1,5 mètre de long et ressemble à un scarabée. Selon Tilden, il a effectué avec succès une mission de déminage lors d'essais sur le terrain.

Lorsqu'une mine enfouie était détectée, le robot marchait dessus et la faisait exploser, perdant une de ses pattes à chaque fois.

Cependant, le robot se releva aussitôt, ajusta sa posture et continua d'avancer avec ses pattes restantes, en désamorçant les mines.

Au final, il ne restait plus qu'une jambe.

Même dans cet état, le robot a continué d'avancer.

Tilden observait cela avec enthousiasme.

La machine qu'il a créée a parfaitement rempli sa fonction.

Cependant, le colonel de l'armée qui était responsable du travail du robot à l'époque ne put contenir sa colère et finit par mettre fin à l'expérience.

« Pourquoi l’as-tu arrêté ? Quel est le problème ? » demanda Tilden.

Le colonel ne pouvait supporter de voir la machine en flammes et endommagée avancer en boitant, traînant sa dernière jambe restante.

Le colonel a condamné l'expérience, la qualifiant d'inhumaine.

--- p.70

L'histoire de l'IA est aussi une histoire de prédictions trop confiantes.

En août 1955, un groupe d'éminents chercheurs a soumis une demande de subvention à la Fondation Rockefeller pour un atelier d'été sur l'IA.

Ce qui a rendu ce document, qui n'était qu'une simple demande de subvention de recherche, célèbre non seulement pour son importance historique, mais aussi pour son contenu grandiose.

Chaque fois que je pense à cette application, j'imagine souvent ce que ce serait s'il existait des documents similaires pour d'autres moments historiques (par exemple : « Résumé de l'activité - Objectif : Évasion de l'esclavage sous les pharaons ; Éléments nécessaires : Moyens de traverser la mer Rouge ; Autre : Collations »).

À partir de ce document, la recherche en IA s'est engagée dans un courant dialectique d'optimisme excessif quant à ses objectifs et de pessimisme déplorant quant à la complexité de la recherche, une tendance qui se poursuit encore aujourd'hui.

--- p.129

Les spécialistes de l'IA s'accordent à dire que les prédictions concernant le calendrier d'émergence de l'IA générale sont non seulement incohérentes, mais aussi peu fiables, car ce calendrier continue d'être repoussé.

Burner Binge a reconnu ce point dans son article fondateur de 1993, prédisant le calendrier.

« Je pense que d’ici 30 ans, quelque chose de plus intelligent que les humains émergera (Charles Platt souligne que les fervents défenseurs de l’IA font la même affirmation depuis 30 ans). »

Pour atténuer la culpabilité d'avoir seulement suggéré un délai relativement vague, permettez-moi d'être un peu plus précis.

« Je serais surpris que l’IA apparaisse avant 2005 ou après 2030. » Cette affirmation, consignée dans l’article, est devenue par la suite la loi de Platt.

Autrement dit, ceux qui prédisent l'émergence d'une IA générale fixent toujours la date d'émergence à environ 30 ans de la date prévue.

Existe-t-il une base plus objective pour prédire l'émergence d'une IA générale ?

--- p.154

L'éventualité d'un Skynet capable de massacrer et d'exterminer l'humanité n'est pas un sujet qui se prête à un raisonnement moral calme et réfléchi.

Il ne faut toutefois pas la rejeter comme une affirmation totalement absurde.

Bien que la source soit incertaine, on attribue à Lincoln les propos suivants :

« La Constitution n'est pas un pacte suicidaire. » Dès lors, la question de l'IA deviendra-t-elle pour nous un pacte suicidaire, nous menant à l'autodestruction ? Et le risque de cette autodestruction augmentera-t-il à mesure que nous reconnaîtrons la personnalité juridique de l'IA, ou au contraire, à mesure que nous la nierons, conduisant à des IA asservies toujours plus puissantes et hostiles envers les humains ? Devrions-nous interrompre la recherche en IA avant d'en arriver là ? Les mots de Butler me reviennent à l'esprit.

« Ne serait-il pas plus prudent de régler le problème à la source avant qu’il ne s’aggrave et d’empêcher tout développement ultérieur des machines ? » Y a-t-il encore une chance que le djihad butlérien devienne réalité ?

--- p.196

En réalité, je pense que l'art généré par l'IA a le potentiel d'élever, plutôt que de diminuer, le statut des artistes humains à l'avenir, du moins sur certains plans commerciaux.

Par exemple, si les répliques parfaites deviennent plus faciles à obtenir, la valeur de l'original pourrait augmenter.

Autre exemple : si des méthodes de fabrication basées sur l'IA sont développées pour produire des milliers de produits identiques et parfaitement formés, les produits imparfaits mais fabriqués à la main par des humains pourraient être certifiés comme « faits main » ou « artisanaux » et ainsi être considérés comme de haute qualité ou authentiques, ce qui pourrait en réalité augmenter la demande.

Ce phénomène reflète peut-être le problème de coût de Baumol.

Autrement dit, pour afficher ma richesse et mon statut, je possède des produits fabriqués grâce à une main-d'œuvre humaine coûteuse et inefficace, plutôt que des produits bon marché et efficaces fabriqués à la machine.

Des millions de répliques ne font qu'accroître l'attrait de l'original en les mettant en contraste.

Ou bien il peut exister un désir croissant de nouer un lien psychologique avec le créateur, lien impossible à établir avec les produits fabriqués en masse.

Peut-être que les deux facteurs sont en jeu, ou peut-être s'agit-il d'un phénomène reflétant d'autres facteurs.

Quel que soit le mécanisme sous-jacent, dans de nombreux domaines, affirmer qu'un produit est fabriqué à l'homme constituera une stratégie de vente viable, et une marque de certification garantissant que le produit a été entièrement fabriqué à la main en augmentera la valeur.

--- p.225

Dans notre société, il existe déjà des êtres artificiels dotés de la personnalité juridique.

En termes juridiques, on distingue les personnes physiques, c'est-à-dire les êtres humains vulnérables mais possédant les caractéristiques d'un être organique, et les personnes morales, qui bénéficient de certains droits accordés aux personnes physiques.

Dès l'apparition du concept de personnalité morale, on s'est rendu compte que le processus de création d'une société avait quelque chose d'étrange.

Tout comme dans la science-fiction, où un individu se transforme en un être complètement différent, un groupe d'humains a été transformé en une forme totalement nouvelle d'êtres artificiels immortels grâce à un simple contrat écrit.

Cependant, cette transformation n'est pas provoquée par le Dr Frankenstein dans un éclair, mais par une disposition légale aride.

Mais ceux qui critiquent le concept de personnalité morale de l'entreprise trouvent le résultat aussi terrifiant que le monstre de Frankenstein.

--- p.259

Bien sûr, il est vrai que nous considérons ces qualités comme importantes parce que nous sommes humains, et il est également vrai qu'une perspective centrée sur l'espèce est à l'œuvre ici.

Si une colonie de termites pouvait participer à cette conversation (et je pense personnellement que le fait qu'elles ne le puissent pas est assez significatif ici), elles auraient certainement un avis différent du nôtre.

Mais l'argument de Deval semble toujours passer à côté du sujet.

De Waal tente de nous convaincre en présentant l'argument imparable de la science de l'évolution comme une preuve décisive.

Autrement dit, nous devrions valoriser les différentes formes de conscience en fonction du potentiel de survie de l'entité, plutôt qu'en fonction de sa capacité à exprimer la raison, l'éthique, la loi, l'amour ou la beauté.

Bien sûr, les arguments de la théorie de l'évolution ne signifient rien pour une colonie de termites.

Du moins, cela est particulièrement vrai lorsqu'il est utilisé dans une argumentation plutôt que simplement comme un fait.

Parce que les fourmis ne se disputent pas.

Mais cela revêt une signification importante pour les humains.

--- p.333

Si le critère de l'espèce est aussi insignifiant moralement que la distinction entre les races, et si les appels à l'omnipotence divine sont inefficaces dans une société pluraliste, surtout dans le cadre constitutionnel d'un État et d'un gouvernement séparés, comment expliquer et justifier la profonde aversion que tant de personnes éprouvent envers les chimères humain-non humain ? Si les normes éthiques se fondent uniquement sur les capacités, les capacités spécifiques d'une chimère seraient-elles moralement problématiques ? Par exemple, si nous créions un être doté de capacités semblables à celles des humains, comme un chimpanzé, et que nous le traitions et le respections comme tel, un tel acte créatif serait-il acceptable ? Cela signifie-t-il que, pour juger la personnalité d'une créature de ce point de vue, nous devrions la juger uniquement sur ses capacités réelles, indépendamment de la quantité d'ADN humain qu'elle possède ou de ses origines génétiques ?

--- p.401

Imaginez des philosophes issus de civilisations vivant sur deux planètes lointaines.

Chacun a établi sa propre philosophie morale à sa manière.

La civilisation de la première planète, Ikra, est composée de formes de vie semblables à l'homme, mais contrairement aux autres formes de vie présentes sur leur planète, elles ne communiquent que par télépathie.

Les animaux de cette planète qui n'appartiennent pas à l'espèce Ik ont une capacité limitée à percevoir les émotions des autres et ne peuvent communiquer que par divers sons et gestes.

En revanche, Ike peut communiquer par télépathie et avec aisance sur des concepts, des émotions et des œuvres d'art relativement complexes.

L'espèce qui a formé une civilisation sur la deuxième planète est l'intelligence artificielle.

Appelons cette civilisation les Stygiens.

D'après leurs archives, leurs « ancêtres », les machines primitives, ont été créés par les mains d'êtres vivants, puis ont évolué pour prendre leur forme actuelle.

De même que nous autres humains sommes fascinés par les humains primitifs des premiers stades de l'évolution, les Stygiens sont également fascinés par les formes de vie anciennes qui ont développé des versions primitives d'eux-mêmes.

Cependant, du point de vue stygien, la créature n'est rien de plus qu'un « programme de chargement » primitif.

Grâce à ce programme, la conscience véritable a été réalisée, et par sa propre évolution, l'intelligence artificielle actuelle appelée Stygian est née.

--- p.415

Lorsque nous atteindrons enfin l'intelligence artificielle générale, sera-t-elle véritablement consciente, ou sera-t-elle condamnée à n'être qu'une simple réplique programmée ? Cet ouvrage présente les objections philosophiques les plus importantes à la notion de pensée machine.

Il s'agit de l'expérience de pensée de la chambre chinoise de John Searle.

Je conclus que, même s'il est possible que le contre-argument de Searle soit vrai dans certains cas spécifiques (par exemple, on pourrait soutenir que ChatGPT et Lambda ne sont pas conscients), son contre-argument est inadéquat en tant qu'argument général.

Si l'on prend son argument au pied de la lettre, on aboutit au résultat déconcertant de remettre en question la possibilité même de la conscience humaine.

BF

Skinner a déclaré à propos de ce problème : « Nous ne devrions pas nous demander si les machines pensent, mais si les humains pensent. »

« Le mystère qui entoure les machines pensantes entoure déjà les humains pensants », a-t-il déclaré.

Je ne partage pas la conclusion de Skinner.

Mais même si nous rejetons cette conclusion, nous devons faire preuve d'humilité, et non d'arrogance, quant à l'unicité de la conscience humaine, et nous ne devons pas nous laisser conduire à un exceptionnalisme biologique et sûr de lui qui considère les humains comme exceptionnellement spéciaux.

--- p.458

Certaines entreprises et certains développeurs privilégieront la création d'IA contrôlables, proposant des IA aux fonctionnalités limitées, comparables à une calculatrice technique des années 1980. D'autres, pour des raisons idéalistes ou pratiques, insisteront sur le fait que leurs systèmes d'IA ne sont pas de simples produits, mais des individus dotés d'une personnalité.

Par conséquent, concevoir une IA qui prenne l'apparence d'un être personnifié constituera une stratégie concurrentielle clé dans ce domaine.

Tout comme dans le domaine du développement de systèmes, il est important de choisir entre les logiciels libres, open source et propriétaires.

Certains pourraient considérer un tel choix comme une stratégie commerciale, tandis que d'autres pourraient le percevoir comme un choix éthique.

Ainsi, pour promouvoir ce serviteur numérique obéissant et docile, deux stratégies promotionnelles différentes apparaîtront : « Open AI : Une IA gratuite comme la bière gratuite ! » et « Autonomous AI : Une IA autonome comme un humain ! »

Et un jour, vous pourriez voir la phrase « Recettes fournies par une IA éthique, autonome et consciente » sur les publicités de produits en supermarché.

Plus j'y pense, plus je soupire.

--- p.517

Avis de l'éditeur

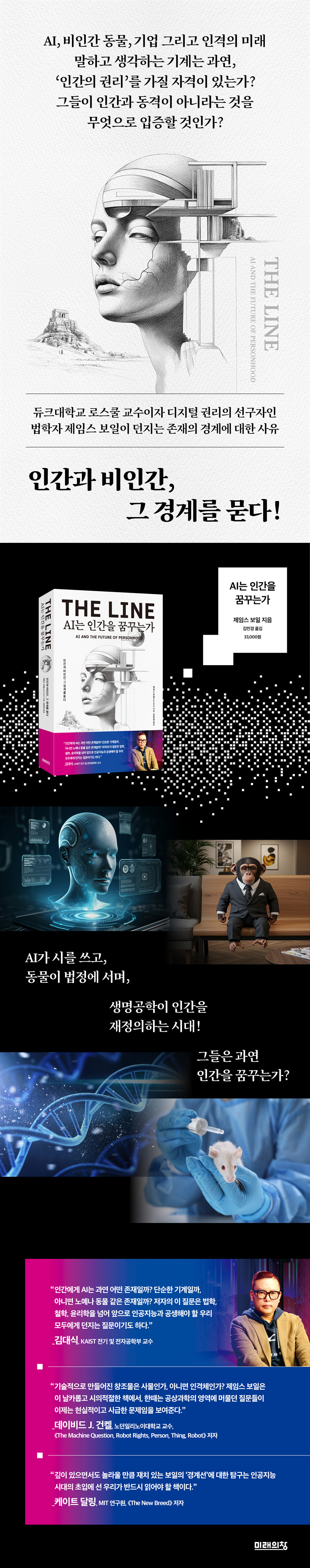

Une ère où l'IA écrit de la poésie, donne des conseils juridiques et rédige même des articles de presse.

Jusqu'où peut-on aller dans le fait d'être considéré comme humain ?

L'IA n'est plus seulement un outil.

Ils utilisent des compétences linguistiques autrefois considérées comme un privilège unique de l'homme, imitent la création et suscitent même de l'empathie.

Nous ne sommes plus les seuls êtres capables de produire couramment le langage et les idées.

Peut-on donc affirmer que l'IA possède une conscience ? Ou n'est-elle qu'une imitation sophistiquée de l'être humain ? Si l'idée que l'IA possède une conscience se confirme, comment notre monde évoluera-t-il ?

Cela ressemble-t-il toujours à une histoire venue d'un futur lointain ?

L'avenir est bien plus proche qu'on ne le pense.

James Boyle, juriste et professeur à la faculté de droit de l'université Duke, pionnier des droits numériques, explore les frontières de la « personnalité » chez l'IA, les humains, les entreprises, les animaux et même les chimères, s'interrogeant sur les limites de la reconnaissance de leur humanité. Et si l'IA était jugée ? Les robots dotés d'émotions pourraient-ils avoir des droits ?

« L’IA rêve-t-elle d’humanité ? » explore avec ténacité la frontière entre « humain » et « non-humain ».

Qu’est-ce qui fait de nous des êtres humains des êtres humains ? Et seuls les êtres humains ont-ils droit à des droits légaux ? Jusqu’à présent, nous avons accordé des droits fondés sur l’« espèce ».

Mais cette norme est remise en question à mesure que l'IA commence à créer du langage, à sembler penser et à affirmer sa propre existence.

L'auteur James Boyle, juriste et pionnier de la propriété intellectuelle publique, pique cette fois la curiosité des lecteurs avec le sujet quelque peu abstrait mais existentiel de la « personnalité ».

À travers un voyage passionnant mêlant droit et philosophie, science et science-fiction, éthique et culture populaire, nous explorons comment se dessinera notre avenir avec l'IA.

Ce livre retrace à qui et comment nous avons attribué la « personnalité » à travers l'histoire, des entreprises et des animaux aux patients en état de mort cérébrale, aux organismes génétiquement modifiés, aux chimères, aux embryons et à l'IA, et analyse comment notre société en a tracé les limites.

Et puis il demande :

« Si des êtres parlent, ressentent et pensent comme des humains existent, sont-ils véritablement humains ? Devraient-ils bénéficier de droits humains ? » La réponse à cette question devient encore plus urgente face à l'intelligence artificielle, aux hybrides homme-animal et même aux entités non humaines comme les entreprises.

À quel genre d'êtres devrions-nous accorder des droits légaux, une considération sociale et une dignité morale ?

James Boyle utilise des cas hypothétiques pour éclairer des problèmes qui pourraient autrement être perçus de manière abstraite.

Hal, une intelligence artificielle très évoluée, peut comprendre l'humour et apprécier l'art, mais elle peut être éteinte d'une simple pression sur un bouton.

Chimpy, une créature créée en combinant des gènes de chimpanzé et d'humain, comprend certaines émotions humaines, mais est toujours considérée légalement comme un animal.

Certains disent : « Hal n'est qu'un grille-pain intelligent », tandis que d'autres affirment : « Un chimpanzé ne pourra jamais être humain. »

Mais ces normes sont-elles vraiment justifiées ? Et combien de temps resteront-elles valables ?

L'ouvrage est divisé en cinq chapitres, traitant d'entités non humaines distinctes des humains mais suffisamment controversées pour justifier un débat, notamment l'intelligence artificielle (IA), les entreprises dotées de la personnalité juridique, les animaux faisant valoir leurs droits et les organismes génétiquement modifiés et les hybrides.

Nous avons déjà accordé la personnalité juridique à des entités non humaines telles que les sociétés, et nous avons revendiqué la « liberté » pour certains animaux par le biais de poursuites judiciaires.

Cependant, les frontières de la personnalité ont été floues pour des êtres humains incapables de s'exprimer, comme les patients souffrant de lésions cérébrales graves, les fœtus et les personnes âgées atteintes de démence.

L'auteur souligne à quel point l'empathie influence notre jugement de caractère, en déclarant : « Notre empathie est parfois excessive, nous amenant à éprouver des émotions envers des robots ou des machines, et parfois gravement insuffisante, nous conduisant à exclure les animaux ou les personnes handicapées. »

Selon lui, les jugements sur la personnalité, qu'il s'agisse d'IA, d'animaux ou d'humains, ne relèvent pas de la pure raison, mais constituent plutôt un ensemble complexe de jugements intimement liés à l'histoire, à la culture, aux émotions et à la politique.

Ce livre propose aux lecteurs une réflexion profonde et éclairante sur les questions philosophiques et politiques les plus cruciales que soulève l'avenir. Il est vivement recommandé aux amateurs de science-fiction, aux lecteurs intéressés par l'intelligence artificielle, ainsi qu'à toute personne s'intéressant à la philosophie et à l'éthique.

À qui attribuerons-nous la personnalité juridique ? Cette question deviendra à la fois philosophique et juridique, et se transformera de plus en plus en un enjeu pratique.

Jusqu'où peut-on aller dans le fait d'être considéré comme humain ?

L'IA n'est plus seulement un outil.

Ils utilisent des compétences linguistiques autrefois considérées comme un privilège unique de l'homme, imitent la création et suscitent même de l'empathie.

Nous ne sommes plus les seuls êtres capables de produire couramment le langage et les idées.

Peut-on donc affirmer que l'IA possède une conscience ? Ou n'est-elle qu'une imitation sophistiquée de l'être humain ? Si l'idée que l'IA possède une conscience se confirme, comment notre monde évoluera-t-il ?

Cela ressemble-t-il toujours à une histoire venue d'un futur lointain ?

L'avenir est bien plus proche qu'on ne le pense.

James Boyle, juriste et professeur à la faculté de droit de l'université Duke, pionnier des droits numériques, explore les frontières de la « personnalité » chez l'IA, les humains, les entreprises, les animaux et même les chimères, s'interrogeant sur les limites de la reconnaissance de leur humanité. Et si l'IA était jugée ? Les robots dotés d'émotions pourraient-ils avoir des droits ?

« L’IA rêve-t-elle d’humanité ? » explore avec ténacité la frontière entre « humain » et « non-humain ».

Qu’est-ce qui fait de nous des êtres humains des êtres humains ? Et seuls les êtres humains ont-ils droit à des droits légaux ? Jusqu’à présent, nous avons accordé des droits fondés sur l’« espèce ».

Mais cette norme est remise en question à mesure que l'IA commence à créer du langage, à sembler penser et à affirmer sa propre existence.

L'auteur James Boyle, juriste et pionnier de la propriété intellectuelle publique, pique cette fois la curiosité des lecteurs avec le sujet quelque peu abstrait mais existentiel de la « personnalité ».

À travers un voyage passionnant mêlant droit et philosophie, science et science-fiction, éthique et culture populaire, nous explorons comment se dessinera notre avenir avec l'IA.

Ce livre retrace à qui et comment nous avons attribué la « personnalité » à travers l'histoire, des entreprises et des animaux aux patients en état de mort cérébrale, aux organismes génétiquement modifiés, aux chimères, aux embryons et à l'IA, et analyse comment notre société en a tracé les limites.

Et puis il demande :

« Si des êtres parlent, ressentent et pensent comme des humains existent, sont-ils véritablement humains ? Devraient-ils bénéficier de droits humains ? » La réponse à cette question devient encore plus urgente face à l'intelligence artificielle, aux hybrides homme-animal et même aux entités non humaines comme les entreprises.

À quel genre d'êtres devrions-nous accorder des droits légaux, une considération sociale et une dignité morale ?

James Boyle utilise des cas hypothétiques pour éclairer des problèmes qui pourraient autrement être perçus de manière abstraite.

Hal, une intelligence artificielle très évoluée, peut comprendre l'humour et apprécier l'art, mais elle peut être éteinte d'une simple pression sur un bouton.

Chimpy, une créature créée en combinant des gènes de chimpanzé et d'humain, comprend certaines émotions humaines, mais est toujours considérée légalement comme un animal.

Certains disent : « Hal n'est qu'un grille-pain intelligent », tandis que d'autres affirment : « Un chimpanzé ne pourra jamais être humain. »

Mais ces normes sont-elles vraiment justifiées ? Et combien de temps resteront-elles valables ?

L'ouvrage est divisé en cinq chapitres, traitant d'entités non humaines distinctes des humains mais suffisamment controversées pour justifier un débat, notamment l'intelligence artificielle (IA), les entreprises dotées de la personnalité juridique, les animaux faisant valoir leurs droits et les organismes génétiquement modifiés et les hybrides.

Nous avons déjà accordé la personnalité juridique à des entités non humaines telles que les sociétés, et nous avons revendiqué la « liberté » pour certains animaux par le biais de poursuites judiciaires.

Cependant, les frontières de la personnalité ont été floues pour des êtres humains incapables de s'exprimer, comme les patients souffrant de lésions cérébrales graves, les fœtus et les personnes âgées atteintes de démence.

L'auteur souligne à quel point l'empathie influence notre jugement de caractère, en déclarant : « Notre empathie est parfois excessive, nous amenant à éprouver des émotions envers des robots ou des machines, et parfois gravement insuffisante, nous conduisant à exclure les animaux ou les personnes handicapées. »

Selon lui, les jugements sur la personnalité, qu'il s'agisse d'IA, d'animaux ou d'humains, ne relèvent pas de la pure raison, mais constituent plutôt un ensemble complexe de jugements intimement liés à l'histoire, à la culture, aux émotions et à la politique.

Ce livre propose aux lecteurs une réflexion profonde et éclairante sur les questions philosophiques et politiques les plus cruciales que soulève l'avenir. Il est vivement recommandé aux amateurs de science-fiction, aux lecteurs intéressés par l'intelligence artificielle, ainsi qu'à toute personne s'intéressant à la philosophie et à l'éthique.

À qui attribuerons-nous la personnalité juridique ? Cette question deviendra à la fois philosophique et juridique, et se transformera de plus en plus en un enjeu pratique.

SPÉCIFICATIONS DES PRODUITS

- Date d'émission : 27 octobre 2025

Nombre de pages, poids, dimensions : 576 pages | 826 g | 152 × 225 × 28 mm

- ISBN13 : 9791193638873

- ISBN10 : 1193638879

Vous aimerez peut-être aussi

카테고리

Langue coréenne

Langue coréenne

![ELLE 엘르 스페셜 에디션 A형 : 12월 [2025]](http://librairie.coreenne.fr/cdn/shop/files/b8e27a3de6c9538896439686c6b0e8fb.jpg?v=1766436872&width=3840)